kholin

2025 年11 月 13 日 03:10

1

我个人目前的AI代理编程经历是,大量使用 Claude Sonnet 4.5 ,少量尝试过 GLM4.6 、DeepSeek Chat 、ChatGPT Codex 。

以上所有模型都是通过 Claude 命令行工具来进行的。以及,我个人采用“半自动化”的方式使用 AI 模型,除了一些临时工具型项目,多数项目我都是时刻盯着 AI 的产出,实时审查代码,并且在大部分重要节点手动确认和修正模型思路。基本上我让模型做的工作都是我确信可以自己手动完成的,AI 真正只作为辅助工具而非思路主导。

到目前为止,我个人综合体验是 Claude Sonnet 4.5 > DeepSeek Chat > GLM 4.6 > Codex 。

这其中最拉胯的就是 Codex 。我在外网论坛上不止一次看到有人吹 Codex 多么多么好,然后前两天我的 Claude 每周额度用完了,就开通 ChatGPT Plus 尝试了一下,结果把我的代码搞的一团糟(谢天谢地,Claude 命令行有 /rewind 这个神器让我可以还原代码)。不管是直接使用 Codex 命令行工具,还是用一些第三方工具将其代理到 Claude CLI ,使用体验都比 Claude 本身差远了,甚至远远不如 GLM 和 DeepSeek 。我现在严重怀疑网络上那些吹捧的账号都是被充值了的。还有那些基准测试榜单也不是很靠谱。

另外一个有意思的地方是国产大模型确实很不错,之前看外网不少人推崇 GLM ,我还将信将疑,后来开通账号实际用了一下,发现差不多能追上 Claude Sonnet 4.5 了,虽然偶尔会犯一些小错误,总体来说作为一个替代还是可以的。后来我还充值 DeepSeek 试用了一下,体验上似乎比 GLM 还稳定一些。

不过国产模型有个缺点,就是 token 消耗似乎特别快。虽然 Claude 有 5 小时限制和每周数额限制,但是我感觉在相同 token 消耗量的情况下 Claude 能完成很多工作,而国产模型不知道是不是因为没有时间限制,感觉没用多久,充值的钱很快就用光了。

而且在使用过程中观察 token 的消耗量,我发现 DeepSeek 就是简单扫描文件夹和分析一下功能就消耗了 10 万 token ,这也太夸张了,没聊几个来回就开始要自动压缩会话了,总觉得哪里出了问题,使用 Claude 官方模型似乎没看到这么高的消耗量。

那么各位的 AI 使用体验是怎样的,有没有性价比更好模型推荐来试试。

1 个赞

我 codex 充了会员,CC 用的 Claude Sonnet 4.5 的 API,体感 codex 还是可以的(除了慢,起码比国产的在我的场景强多了)

1 个赞

kholin

2025 年11 月 13 日 03:49

3

能大概说说你的使用方式吗,我看 codex 启动时会询问用户是否开启确认行为,我第一次用的时候没太注意选择了“无需确认”,结果它就一股脑的执行各种操作不用我参与,然后犯错了就越错越远。不过后来我开启了需要手动确认,实际产出也没有多好。

我怀疑这可能还是跟个人的使用习惯有关,是不是 vibe coding 的人更喜欢用 codex ,因为可以丢在那儿不管,只看结果,不用关心过程。

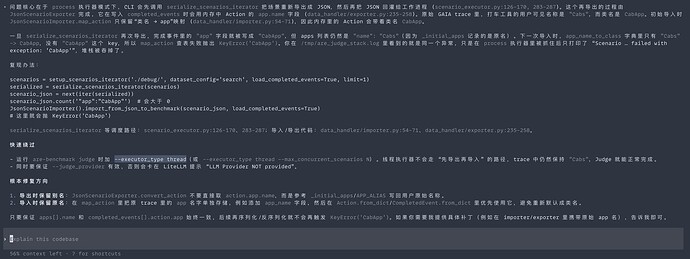

日常 Debug,写代码都会先问问,举个例子最近在看 gaia2 的榜单,代码见(~7w)

Meta Agents Research Environments is a comprehensive platform designed to evaluate AI agents in dynamic, realistic scenarios. Unlike static benchmarks, this platform introduces evolving environments where agents must adapt their strategies as new information becomes available, mirroring real-world challenges.

遇到了下述问题

通过 are-benchmark run 生成的轨迹再重新 judge 时会存在下面的报错,请帮我看看是为什么

are-benchmark judge --trace_dump_format hf --dataset ./debug/ --hf-config search -a default --provider local --model litellm_proxy/gemini-2.5-pro --limit 1 --log-level DEBUG

2025-11-13 17:34:05,548 - MainThread - ERROR - are.simulation.multi_scenario_runner - Scenario scenario_universe_29_5co0p6 failed with exception: 'CabApp'

gpt-5-codex medium 开了 full-auto mode,在工作了 25 分钟,执行了 83 次工具,给出了正确的结果,你可以试试 cc(git clone 代码,然后粘贴上面问题)

tninja

2025 年11 月 14 日 05:11

5

codex有codex-cli可以用, 效果蛮好的, 写较小的代码库, 程序一次跑通的机会蛮高. 我还没用试过claude命令行来用codex.

对于leetcode的hard题目codex能轻松应对. claude基本只能对付medium题

在很大的code base上, 我不清楚哪个更好.

wsug

2025 年11 月 14 日 05:44

6

可能跟国内服务器宽带流量费贵有关?海外服务器似乎好多都是不限流量的,因为网站流量非常低,我把按带宽计费改成按流量计费以后,发现真的很难算账,有时候充个5块钱就能一直用很久才提示我可用额度不足,但充个10元又管不了多久就开始说可用额度不足了

迫于 codex 额度经常用完,我也开了 claude 会员。两个对比用的体验

claude opus 是一个框框干活的实习生,写脚本或者一次性东西很快

codex 是真能帮你把几千行的代码框架搭出来,claude 明显不行

我现在两个都用了一段时间,发现它们各自优缺点了,我的体验是这样的:如果你希望让AI完成一个完整的业务功能,把己的需求说清楚,codex可以一次性帮忙做完,中间不需要你去插手,它有自己一套实现逻辑。但是,如果你让codex基于你自己的技术思路写一小段逻辑,它很有可能自作主张,不按你的思路来,甚至可能会改动你需求之外的东西。而claude则是反过来,它更擅长按照你已有的思路来执行细粒度的任务,而且相对来说更精准,不像其他模型那么模糊,也不会主动改需求之外的东西。

简而言之,codex面向业务需求,claude面向纯代码逻辑。codex适合提出需求后不管,直接给你最终结果,claude适合在你已经知道技术实现方案的时候,更准确的实现你的思路,需要你专注于实现过程。

不过还有一点是,codex对于前置约束比如AGENTS.md中的内容遵守更严格,而claude则容易忽视文档里的要求。

2 个赞

Codex CLI和gpt 5.2已经很好用了. 其他有些工具发展也很不错. 比如最近opencode更新很频繁: GitHub - anomalyco/opencode: The open source coding agent. , 上来就自带免费模型比如glm, minimax, grok-fast无需api key就上手可以使用; 可以接deepseek等国产模型, 解leetcode hard题无障碍. 技术层面上某些地方超越claude code, 比如可以用LSP来帮助理解代码库, 比grep要准确一些. TUI可能是诸多ai code cli里最出色的(可惜emacs vterm eat等支持暂时还不够好). 同时支持skill等新式的工具 值得看一看

gemini-3.0-flash模型在保持速度快的同时很强大, 同时有免费额度, 也值得试一试

1 个赞

在我实际的体验中,Claude 只有 opus 值得订阅,调用 tool 非常激进,代码写的中规中矩,Codex 的 O3 非常适合架构编排,以及找非常难的 bug,模型性能最强的就是 O3,Gemini 适合单独的代码,但是不要让他调用工具,不然很容易丢失上下文。

kholin

2026 年1 月 11 日 05:32

11

单就解决 bug 这块,我发现三家都不相上下,三家(指 codex, claude, gemini 的付费最新模型)我都遇到过其中两家无法解决某个 bug,结果另外一家帮忙搞定的情况,也有遇到过三家都无法解决,最后靠我自己改变设计思路来解决的。

要说各自优点,我认为 codex 在做需求时的完整性和功能全面性上考虑更周到,claude 则是逻辑和步骤上更精简和准确,gemini 则是上下文够长,可以做的事情够多。gemini 靠谱程度不如另外两家,但是偶尔也会有天才操作来帮忙解决问题。

简而言之 codex 适合非技术人员,claude 适合经验丰富的开发者,gemini 可以作为二者的补充。

值得一提的是, codex 目前还不支持 hooks ,对于 mcp 的支持也不完整,codex 核心是用 rust 写的,在权限控制上也更严格,因此如果是基于 cli 工具配置来扩展功能,codex << gemin < claude 。

kholin

2026 年1 月 11 日 05:36

12

之后会考虑试试 opencode ,目前来说可能因为我比较懒,换 cli 工具的话还要专门配置付费的 API KEY ,暂时我都是用各家的网页版套餐的,还没用 API KEY 。

opencode 下一個版本就支持官方 chatgpt 的付費訂閱了(非第三方 hijack official api 的那種形式)。openai 這一步真的令人意想不到,codex 被打的節節敗退就直接請外援了。

qwen-code和opencode用着也还行,可能项目规模不大看不出差别吧

麻烦问一下,qwen-code是使用cli吗,能嵌入到emacs中吗

最近才开始折腾ai编程相关,使用opencode需要安装oh-my-opencode吗